6G显存玩转130亿参数大模型 RTX 2060用户发来贺电 AMD不配吗?

Meta的大语言模型LLaMA 13B,现在用2060就能跑了~

羊驼家族的Alpaca和Vicuna也都能运行,显存最低只需要6G,简直是低VRAM用户的福音有木有。

(资料图片仅供参考)

(资料图片仅供参考)

GitHub上的搭建教程火了之后,网友们纷纷跑来问苹果M2是不是也能跑。

这通操作的大致原理是利用最新版CUDA,可以将Transformer中任意数量的层放在GPU上运行。

与此前llama.cpp项目完全运行在CPU相比,用GPU替代一半的CPU可以将效率提高将近2倍。

而如果纯用GPU,这一数字将变成6倍。

网友实测的结果中,使用CPU每秒能跑2.1个token,而用GPU能跑3.2个。

生成的内容上,开发者成功用它跑出了“尼采文学”。

如何操作在开始搭建之前,我们需要先申请获得LLaMA的访问权限。

传送门:https://ai.facebook.com/blog/large-language-model-llama-meta-ai/

此外还需要有一个Linux环境。(Windows用户可以用WSL2)

准备工作完成之后,第一步是将llama.cpp克隆到本地。

如果没有安装CUDA,可以参考下面的步骤:

然后是建立micromamba环境,安装Python和PyTorch等工具。

接着需要在micromamba环境下安装一些包:

然后运行Python脚本以执行转换过程:

之后将其量化为4bit模式。

接着是新建一个txt文本文档,把提示词输入进去,然后就可以运行了。

这步当中-ngl后面的数字是可以修改的,它代表了转换层的数量。

当该值为18时,运行中消耗的VRAM为5.5GB,根据显存的大小最高可以调至40。

网友:AMD不配吗

这一教程出现之后,网友们的新玩具又增加了。

“苦OpenAI久矣”的网友更是感觉仿佛找到了光。

这位网友就表示自己太期待在自己的设备上运行LLM了,宁愿花5千美元购置设备也不想给OpenAI交一分钱。

但AMD用户可能就不那么兴奋了,甚至透露出了嫉妒之情。

这套方法要用到CUDA(英伟达专用),所以AMD是不配了吗?

那么,你期待用自己的设备跑大语言模型吗?

关键词:

-

6G显存玩转130亿参数大模型 RTX 2060用户发来贺电 AMD不配吗?

2023-05-19 -

速读:一图读懂 | 智“汇”湾区最新成绩单来了!

2023-05-19 -

中国旅游日|9张海报游遍大美鹤岗 环球时讯

2023-05-19 -

国家医保局:逐步将适宜的分娩镇痛和辅助生殖技术项目按程序纳入基金支付范围 环球百事通

2023-05-19 -

天天微速讯:故宫“数字文物库”文物总数已超10万件

2023-05-19 -

环球今头条!农业企业生产成本结转会计分录_农业企业生产成本

2023-05-19 -

山西和顺赴京招商引资推介签约总投资138亿元-环球视点

2023-05-19 -

全球热议:农业银行董事长谷澍会见TCL集团董事长李东生一行

2023-05-19 -

桂博士汽车美容怎么样 桂博士汽车美容的加盟条件?

2023-05-19 -

天天观热点:不用验孕棒验孕小妙招 不用验孕棒验孕怎么知道自己怀孕了

2023-05-19 -

拖欠15亿的戴威再创业:用户狂喷、天猫先急眼了?

2023-05-19 -

【当前独家】语文句子语法结构(语文句子成分)

2023-05-19 -

最新消息:狄耐克(300884)盘中异动 股价振幅达7.55% 上涨6.24%(05-19)

2023-05-19 -

达达快送鲜花蛋糕品类配送单量在520前夕同比上涨100%

2023-05-19 -

加强调查研究,推动青浦区文化创意产业内涵式、高质量发展

2023-05-19 -

碳达峰碳中和科技论坛、2023中国科幻大会将举办

2023-05-19 -

公募基金加速布局,积极型养老目标风险基金“增员” 焦点快播

2023-05-19 -

生活照片是5寸还是6寸(生活照片是5寸还是6寸还是7寸)

2023-05-19 -

CCTV5直播世乒赛:4-1打哭日本伊藤美诚,世界第一孙颖莎再次冲冠_全球快讯

2023-05-19 -

祖国我心中的一首歌朗诵词 祖国我心中的一首歌朗诵稿

2023-05-19 -

野老与人争席罢海鸥何事更相疑停顿_野老与人争席罢海鸥何事更相疑

2023-05-19 -

积分受让人是什么意思_受让人是什么意思

2023-05-18 -

中科曙光:公司主要液冷产品包括模块化数据中心等已在多地区、多领域落地应用

2023-05-18 -

天天新动态:万物同“苏” 待游子归来

2023-05-18 -

美林维持龙湖“买入”评级:提前偿还外债,销售增长稳健、扩大土地储备

2023-05-18 -

永吉农商行支农支小“有情怀 有力度”

2023-05-18 -

大批法国游客涌入中国,表面是旅游,实则为了我国的美食和白酒?

2023-05-18 -

海洋馆有什么(海洋馆里有什么) 每日速看

2023-05-18 -

中小学学制从“ 633 ”改为“ 522 ” ?学生或提前 3 年高考

2023-05-18 -

当前聚焦:国六b大马力汕德卡怎么样?卡友说:节油才是王道!

2023-05-18

-

守住网络直播的伦理底线

2021-12-16 -

石窟寺文化需要基于保护的“新开发”

2021-12-16 -

电影工作者不能远离生活

2021-12-16 -

提升隧道安全管控能力 智慧高速让司乘安心

2021-12-16 -

人民财评:提升消费体验,服务同样重要

2021-12-16 -

卫冕?突破?旗手?——武大靖留给北京冬奥会三大悬念

2021-12-16 -

新能源车险专属条款出台“三电”系统、起火燃烧等都可保

2021-12-16 -

美术作品中的党史 | 第97集《窗外》

2021-12-16 -

基金销售业务违规!浦发银行厦门分行等被厦门证监局责令改正

2021-12-16 -

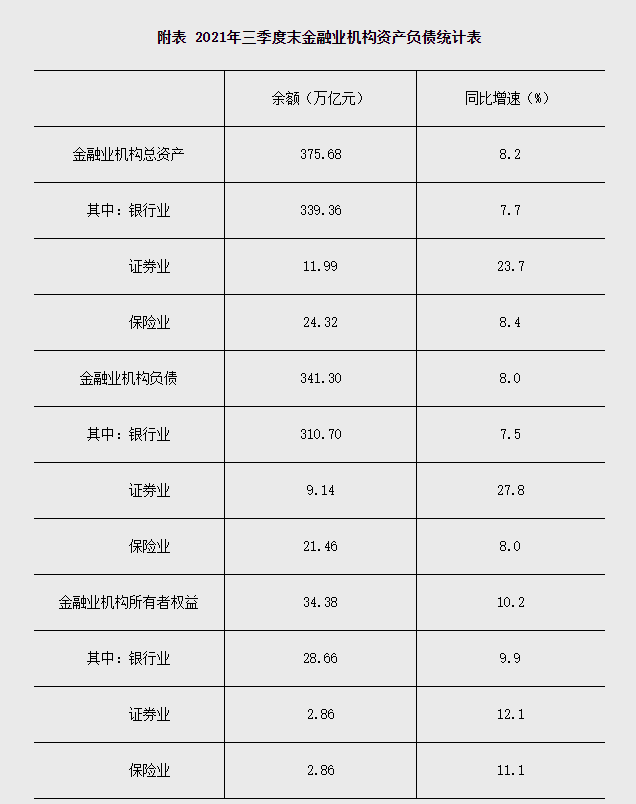

保持稳定发展有支撑——从11月“成绩单”看中国经济走势

2021-12-16